atom.cs-automator.classification-accuracy-review

分類精度を定期的に検証する

分類精度を定期的に検証する レストランでは、料理の味が安定しているか「味見」を定期的にしますよね。AI の自動分類(=お客様の問い合わせを自動でカテゴリ分けすること)も同じです。最初は正しく分類していても、お客様の...

成果物成果物このレッスンが終わったとき、あなたの手元に残る具体的な成果物です(例: 公開済みの Web ページ、動作するフォームなど)。

証跡証跡成果物が正しく作れたことを確認するためのチェックリストです(例: ブラウザで動作する、フォーム送信で値が保存される)。

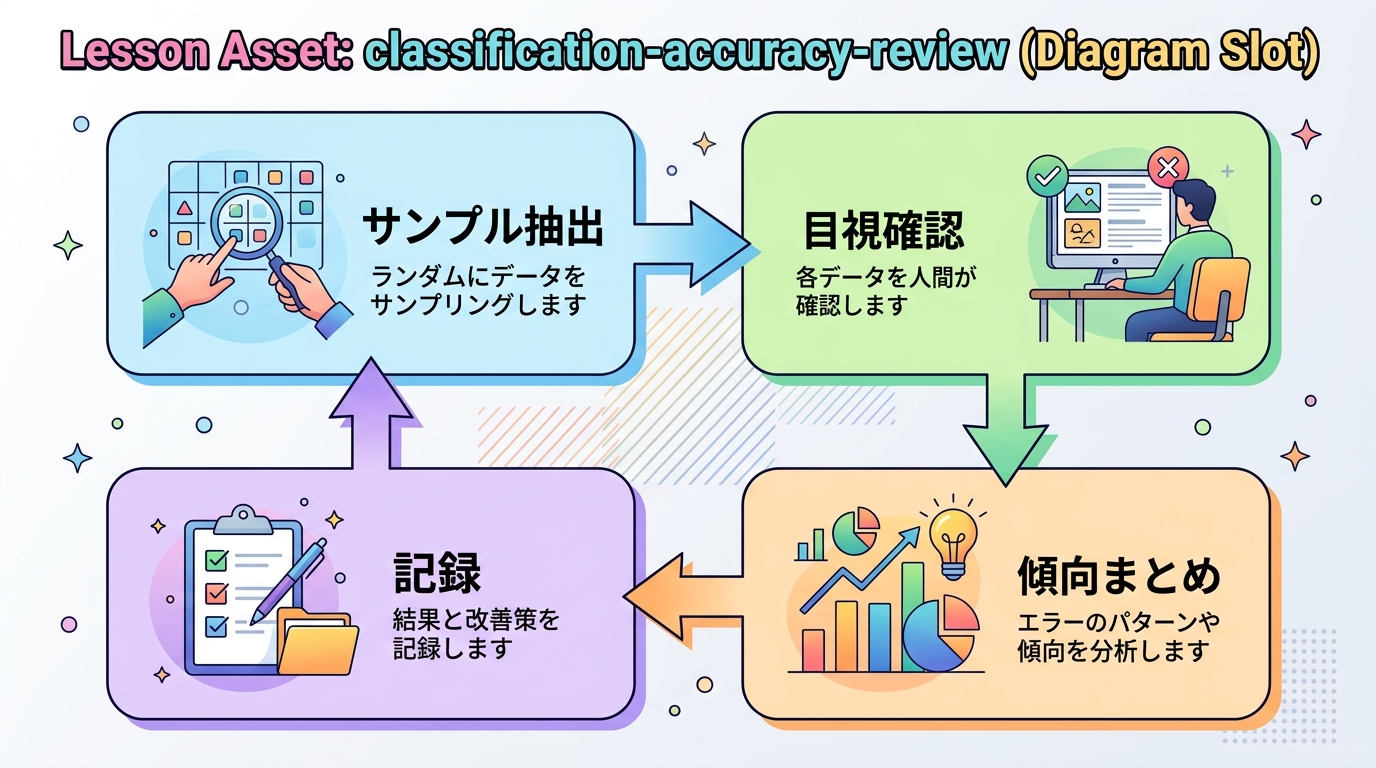

メディアメディアレッスン内に出てくる図や動画のスロットです。実際の画面やイメージで理解を補助します。

レッスン本文

分類精度を定期的に検証する

レストランでは、料理の味が安定しているか「味見」を定期的にしますよね。AI の自動分類(=お客様の問い合わせを自動でカテゴリ分けすること)も同じです。最初は正しく分類していても、お客様の問い合わせの傾向が変わると、だんだん精度が落ちることがあります。

このレッスンでは、分類の正しさを「定期的に味見する」習慣を 15 分で身につけます。最終的に、検証結果をまとめた記録ドキュメントを 1 枚完成させるのがゴールです。

前提を確認する

このレッスンを進める前に、次の 2 つを満たしているか確認してください。

- AI を使った自動分類がすでに動いていること(手動でカテゴリ分けしている場合でも OK)

- 分類結果を見られる場所(スプレッドシート、管理画面など)があること

どちらかが準備できていない場合は、先に分類のしくみを整えましょう。

サンプルを取り出す

まず、直近の分類結果から 20〜30 件 をランダムに取り出します。ここが検証の「味見」にあたるステップです。

AI に頼んで取り出す方法

ChatGPT や Claude に、次のようなプロンプト(=AI への指示文)を送ってみましょう。

以下のスプレッドシートから、直近 1 週間の問い合わせをランダムに 25 件選んでください。選んだ行の「問い合わせ内容」と「AIが付けたカテゴリ」の 2 列だけ表にしてください。

スプレッドシートの中身をコピー&ペーストで貼り付ければ、AI がランダム抽出してくれます。

良い例

- 「直近 1 週間の問い合わせからランダムに 25 件選ぶ」

悪い例

- 「最初の 25 件を選ぶ」(古いデータばかりになる可能性がある)

- 「気になるものだけ選ぶ」(無意識に偏りが出やすい)

正しいか目視で確認する

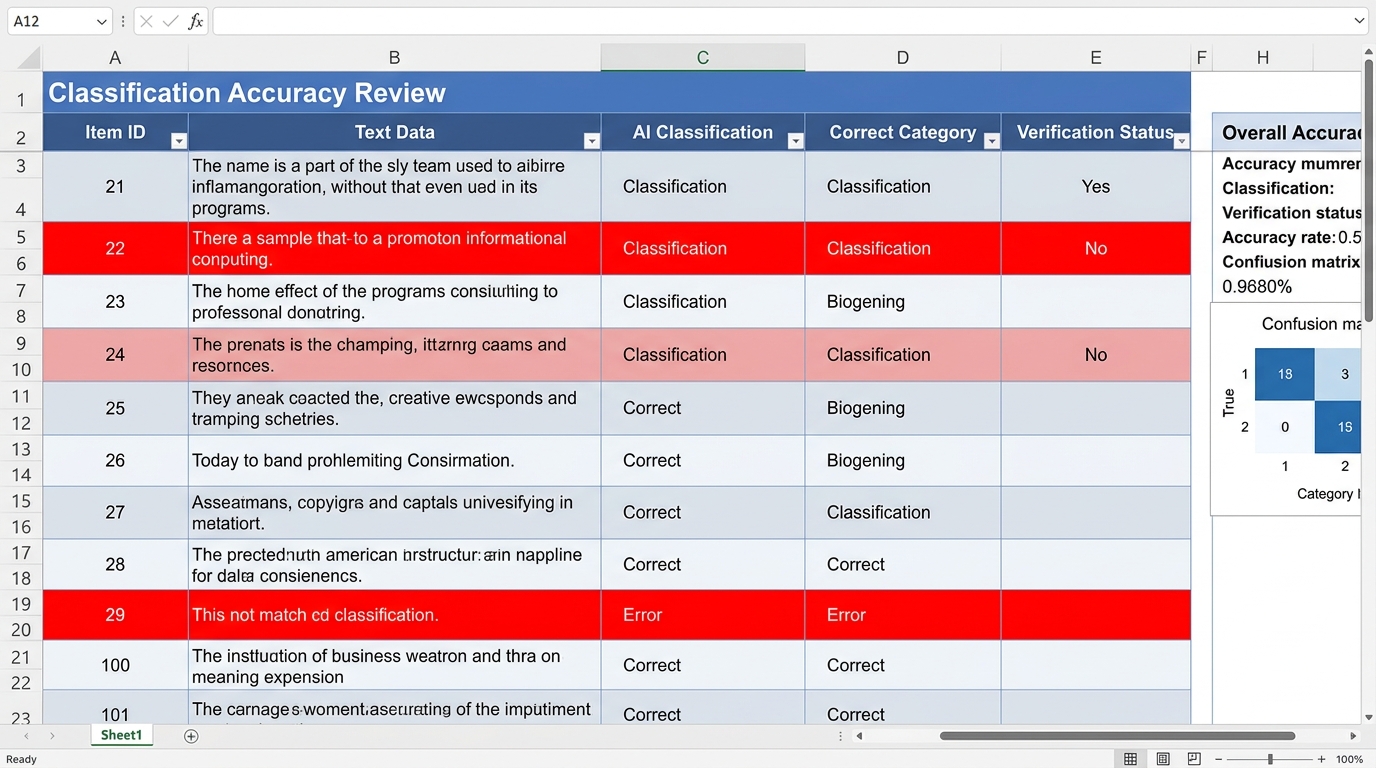

取り出したサンプルを 1 件ずつ見ていきます。「AI が選んだカテゴリ」と「本当はどのカテゴリが正しいか」を比べて、合っているか確認しましょう。

確認のしかた:

| AI が付けたカテゴリ | あなたの判断 | 結果 |

|---|---|---|

| 返金 | 返金 | ✅ 合っている |

| キャンセル | 返金 | ❌ 違う(返金が正解) |

| 配送 | 配送 | ✅ 合っている |

- 合っている → そのまま次へ

- 違っている → 「本当はどのカテゴリか」をメモする

- どちらか迷う → 「判定保留」として記録する(無理に決めなくて OK)

間違いの傾向をまとめる

すべて確認したら、結果を数字でまとめます。「だいたい合ってそう」ではなく、数字で記録するのが大切です。次回の検証と比較できるようになります。

| 確認項目 | 記入例 |

|---|---|

| 確認日付 | 2025-01-15 |

| 確認件数 | 25 件 |

| 正解件数 | 22 件 |

| 精度(%) | 88% |

| よくある間違い | 「返金」を「キャンセル」と分類していた |

| 判定保留 | 2 件(「その他」に入れるべきか不明) |

AI に傾向分析を頼む

間違いが複数あった場合、AI に傾向を分析してもらうと便利です。次のプロンプトを試してください。

以下は AI の自動分類を人間が確認した結果です。間違っていたものの一覧を見て、どんなパターンの間違いが多いか分析してください。改善策があれば提案してください。

(間違っていた件の一覧をここに貼る)

良い例

- 「精度 88%。『返金』と『キャンセル』の混同が 3 件。カテゴリ定義の明確化を検討」

悪い例

- 「だいたい合ってそう」(数値がなく、次回と比較できない)

検証結果を記録する

最後に、確認結果をドキュメント(=記録用の文章ファイル)にまとめます。日付と数値を残しておくと、精度の推移(=上がっているか下がっているか)がわかるようになります。

AI ツールに次のように指示すると、きれいに整形された記録ドキュメントが作れます。

以下の情報をもとに、分類精度の検証レポートを作ってください。

- 確認日: 2025-01-15

- 確認件数: 25 件

- 正解件数: 22 件

- よくある間違い: 「返金」を「キャンセル」と分類(3 件)

- 判定保留: 2 件

前回の精度(もしあれば)と比較するセクションも入れてください。

このドキュメントが今回の成果物です。スクリーンショットを撮って保存しておきましょう。

つまずきポイントに対処する

- 「そもそも何が正解かわからない」場合 → その件は「判定保留」として記録し、チームメンバーに相談しましょう。判定保留が全体の 20% を超えるなら、カテゴリの定義自体があいまいかもしれません。

- 精度が低すぎる(70% 未満など)場合 → 分類のカテゴリ数が多すぎるか、カテゴリの境界があいまいな可能性があります。AI に「カテゴリの定義を整理したい。現在のカテゴリ一覧は〇〇です」と相談してみましょう。

- 検証を忘れてしまう場合 → カレンダーに「毎週〇曜日に分類チェック(15 分)」とリマインダー(=予定の通知)を入れておきましょう。

- 件数が少なくて検証できない場合 → 2 週間分をまとめて確認しても OK です。ただし 10 件未満だと傾向がつかめないので、最低 10 件は集めましょう。

完了を確認する

次の 3 つが揃っていれば、このレッスンは完了です。

- ✅ 20 件以上のサンプルを確認した

- ✅ 精度(パーセント)とよくある間違いの傾向を数字でまとめた

- ✅ 検証結果の記録ドキュメントを保存した(スクリーンショットでも OK)

種類: markdown_doc

検証: basic_manual_check_v1

証跡証跡成果物が正しく作れたことを確認するためのチェックリストです(例: ブラウザで動作する、フォーム送信で値が保存される)。

メディア

必須

なし

あると楽

なし