atom.cs-automator.hallucination-guard

事実と異なる回答を防止する

AIの事実と違う回答を防ぐ 想像してみてください。あなたのお店に、知識豊富だけど時々いい加減なことを言う新人スタッフが入りました。お客様への回答をそのまま任せて大丈夫でしょうか?必ず確認しますよね。 AI(=人工知...

成果物成果物このレッスンが終わったとき、あなたの手元に残る具体的な成果物です(例: 公開済みの Web ページ、動作するフォームなど)。

証跡証跡成果物が正しく作れたことを確認するためのチェックリストです(例: ブラウザで動作する、フォーム送信で値が保存される)。

メディアメディアレッスン内に出てくる図や動画のスロットです。実際の画面やイメージで理解を補助します。

レッスン本文

AIの事実と違う回答を防ぐ

想像してみてください。あなたのお店に、知識豊富だけど時々いい加減なことを言う新人スタッフが入りました。お客様への回答をそのまま任せて大丈夫でしょうか?必ず確認しますよね。

AI(=人工知能のこと。ChatGPTやClaudeなどを指します)も同じです。とても便利ですが、ときどきもっともらしいウソをつくことがあります。これを「ハルシネーション(=もっともらしい嘘)」と呼びます。

このレッスンでは、ハルシネーションを防ぐプロンプト(=AIへの指示文)の書き方と、AIの回答を素早く確認する方法を学びます。最終的に、あなた専用の「ハルシネーション防止プロンプトひな形」を1つ作って保存します。

ハルシネーションが起きる仕組みを知る

ハルシネーションとは、AIが事実でないことを自信満々に話す現象です。悪意があるわけではなく、AIが「もっともらしい回答」を組み立てる性質上、どうしても起こります。

たとえるなら、テストで分からない問題に直面した学生が、白紙で出すのではなく、なんとなくそれっぽい答えを書いてしまうのに似ています。AIも「分かりません」と言わずに、何かしら答えを作ってしまうのです。

よくあるハルシネーションのパターン

| パターン | 具体例 |

|---|---|

| 数字のでっちあげ | 「返品期限は30日です」(実際は14日) |

| 存在しないルールの創作 | 「初回購入者は送料無料です」(そんなルールはない) |

| 古い情報を現在形で語る | 「営業時間は9時〜17時です」(すでに10時〜18時に変更済み) |

防止プロンプトの型を覚える

プロンプトの書き方ひとつで、ハルシネーションを大きく減らせます。ポイントは3つです。

- 根拠を限定する — 「この資料だけを使って答えて」と伝える

- 分からないときは正直に言わせる — 「分からなければ『分かりません』と答えて」と伝える

- 出典を示させる — 「回答の根拠を引用して」と伝える

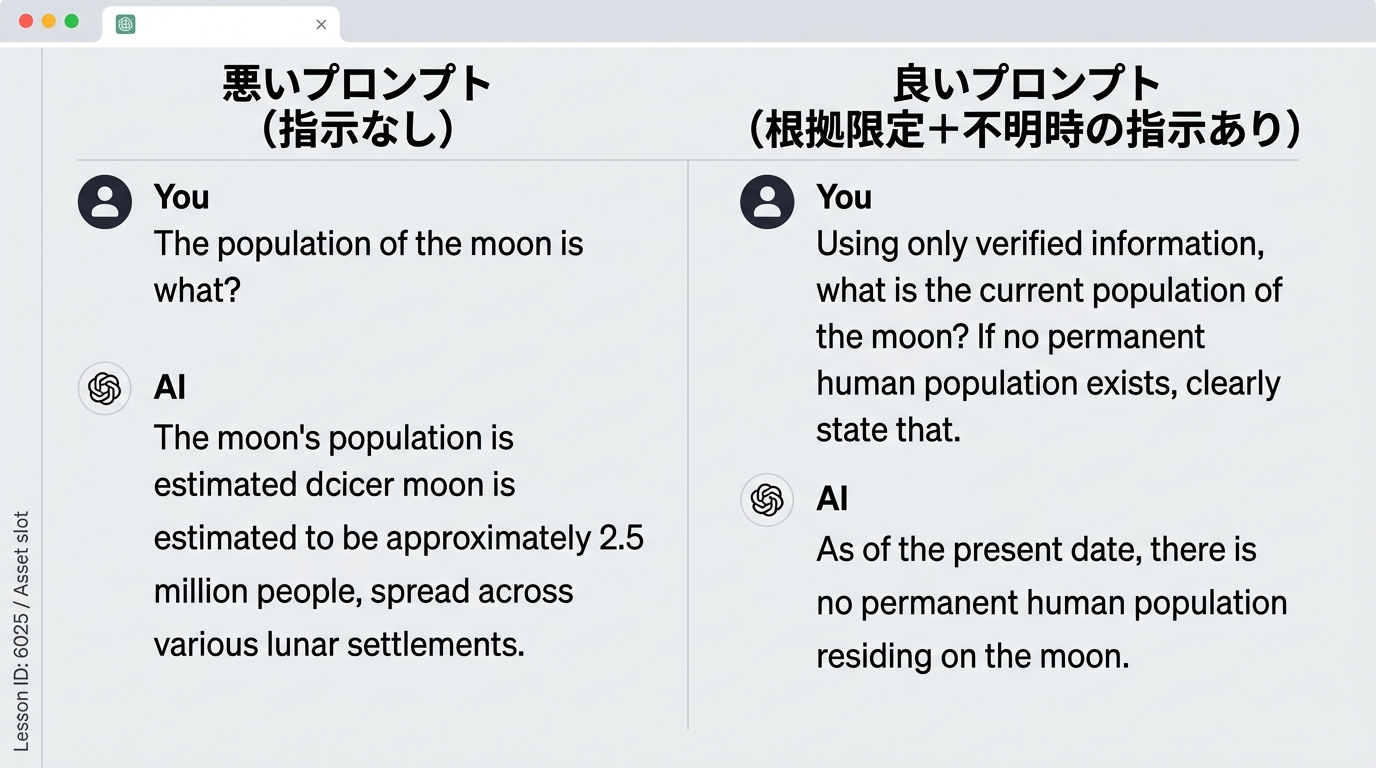

実際にAIに送ってみるプロンプト

以下をChatGPTやClaudeにそのままコピペして試してみましょう。【ここに貼る】 の部分だけ、あなたの社内マニュアルの文章に差し替えてください。

良い例(防止プロンプトあり):

あなたはカスタマーサポート担当です。

以下のルールを必ず守ってください。

1. 回答は下の「参考資料」に書かれている内容だけを使ってください

2. 参考資料に載っていない質問には「確認して折り返します」と答えてください

3. 数字(金額・期限・日数など)を答えるときは、参考資料の該当箇所を「」で引用してください

---

参考資料:

【ここにあなたの社内マニュアルや FAQ の文章を貼る】

---

お客様の質問: 返品はできますか?

悪い例(防止プロンプトなし):

返品について詳しく教えて

違いが分かりましたか?良い例では、AIに「答えられる範囲」と「分からないときの振る舞い」を明確に伝えています。悪い例では、AIが知識を勝手に補って答えてしまいます。

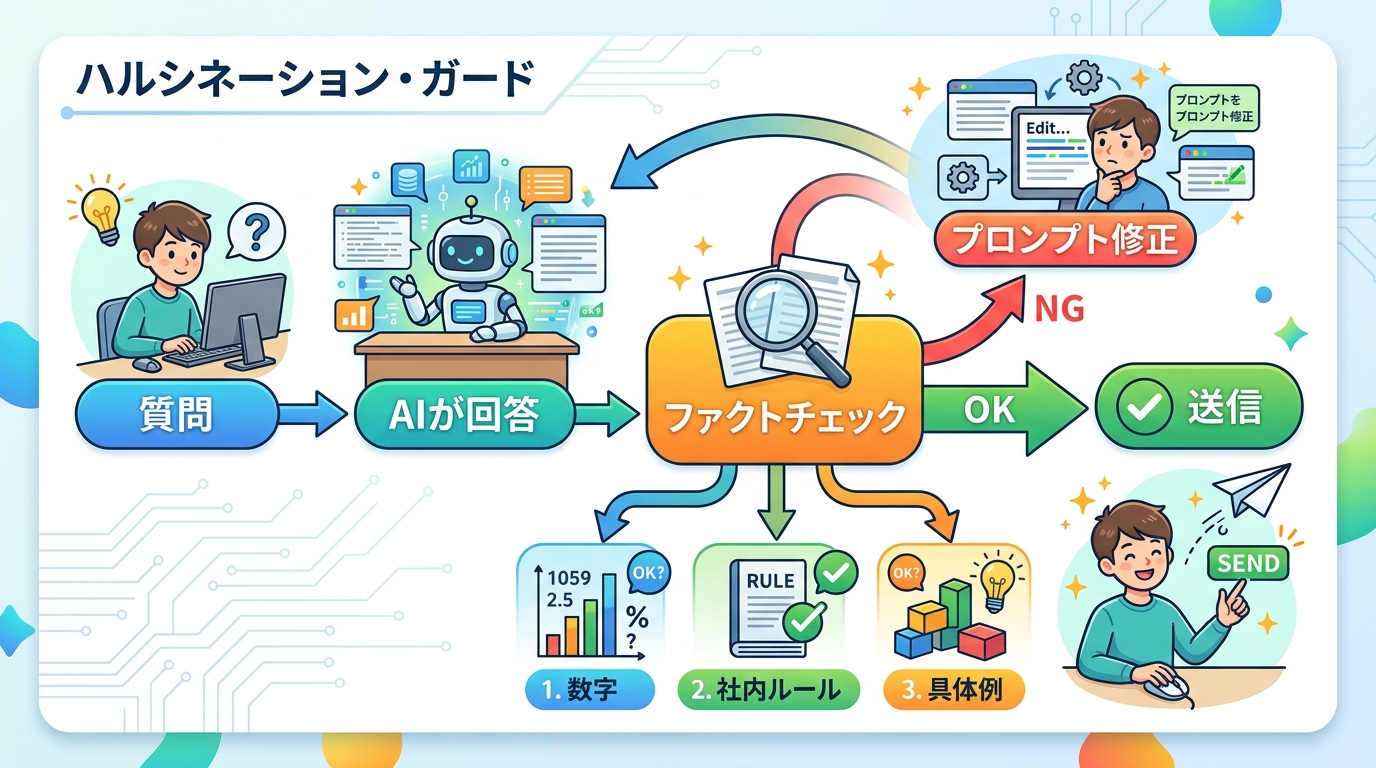

AIの回答を30秒で確認する

AIから回答をもらったら、お客様に送る前に必ず確認します。この確認を「ファクトチェック(=事実確認)」と呼びます。

全部を疑う必要はありません。次の2点に絞ると、30秒〜1分で終わります。

確認ポイント2つ

- 数字と日付は正確か? — 「14日」「3,000円」などの数字を社内マニュアルと照合する

- 社内ルールと一致しているか? — ポリシーや手順が実際のものと合っているか確認する

AIに確認を手伝ってもらうプロンプト

AI自身にダブルチェックさせることもできます。回答を受け取った後、こう聞いてみましょう。

いまの回答に含まれる数字と社内ルールを箇条書きで抜き出してください。

それぞれ「参考資料のどこに書いてあるか」を併記してください。

参考資料に根拠がないものは「根拠なし」と明記してください。

「根拠なし」が出てきたら、その部分がハルシネーションの可能性ありです。社内マニュアルで確認してから回答を修正しましょう。

確認チェックリストを作る

あなたの仕事でよくある質問パターンを想定して、確認ポイントをまとめましょう。

良い例:

| 確認項目 | チェック方法 | 結果 |

|---|---|---|

| 返品期限はマニュアル通りか | マニュアルP.12と照合 | ✅ 14日以内 |

| 返品送料の負担は正しいか | マニュアルP.12と照合 | ✅ お客様負担 |

| AIが引用した根拠は実在するか | 原文を目視確認 | ✅ 該当箇所あり |

悪い例:

- AIの回答をそのままコピペする(確認ゼロ)

- 「なんか合ってそう」で送信する

成果物をまとめる

ここまでの内容を使って、以下を1つのドキュメントにまとめましょう。メモ帳やGoogleドキュメントなど、何でも構いません。

作るもの

- あなた専用のハルシネーション防止プロンプト — 上の「良い例」をベースに、あなたの仕事内容に合わせてカスタマイズしたもの

- 比較スクリーンショット — 「防止プロンプトなし」と「防止プロンプトあり」でAIの回答がどう変わったか、画面をスクリーンショットで保存したもの

完了チェック

次の3つすべてに「はい」と言えたら、このレッスンは完了です。

- 防止プロンプトに「根拠の限定」「分からないときの振る舞い」「出典の引用」の3要素が入っている

- AIに実際にプロンプトを送って、回答が改善されることを確認した

- 比較スクリーンショットを保存した

つまずきポイントに対処する

「AIが自信満々に答えるから、つい信じてしまう」 → AIの自信と正確さは別ものです。人間でも「自信満々だけど間違っている人」いますよね。AIも同じです。数字と社内ルールの2点だけ確認する習慣をつけましょう。

「確認に時間がかかりすぎる」 → 最初は3分かかっても大丈夫です。慣れると30秒でできるようになります。まずは「数字」だけに絞って確認を始めましょう。全部を一度にチェックしようとしないのがコツです。

「どんなプロンプトを書けばいいか分からない」

→ このレッスンの「良い例」をそのままコピペして、【ここに貼る】の部分だけ差し替えてください。最初から完璧なプロンプトを書く必要はありません。使いながら少しずつ改善していけば大丈夫です。

「参考資料が長すぎてAIに送れない」 → 全部を一度に送る必要はありません。質問に関係しそうな部分(1〜2ページ分)だけを貼り付ければ十分です。ChatGPTもClaudeも、必要な部分だけ送るほうが正確に答えてくれます。

種類: markdown_doc

検証: basic_manual_check_v1

証跡証跡成果物が正しく作れたことを確認するためのチェックリストです(例: ブラウザで動作する、フォーム送信で値が保存される)。

メディア

必須

なし

あると楽

なし